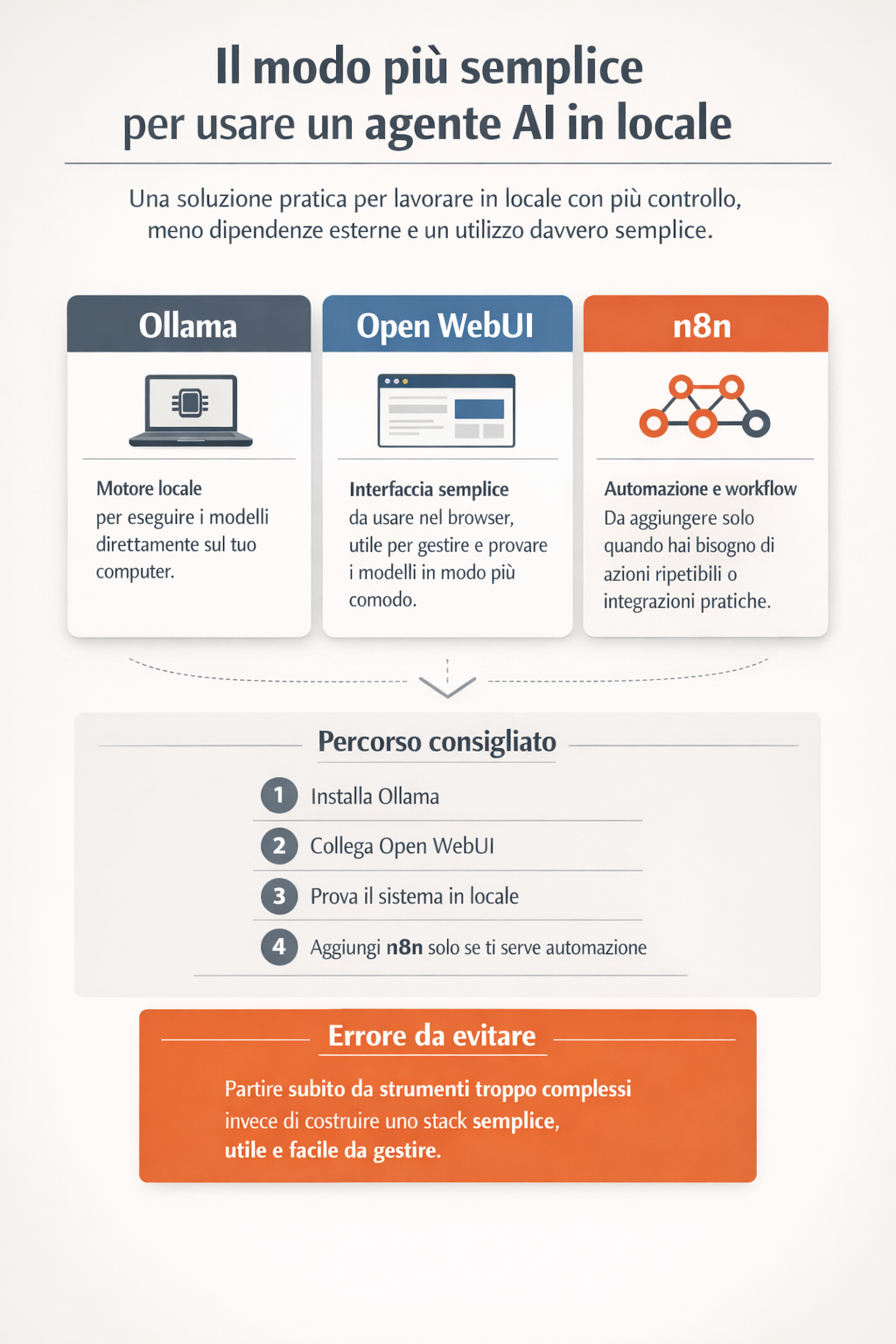

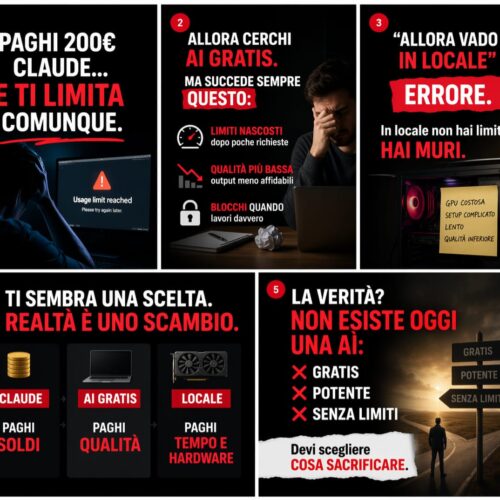

C’è un punto che ormai conviene dire senza girarci intorno: se stai cercando un’AI cloud davvero gratis, davvero illimitata e anche semplice da usare ogni giorno, stai inseguendo una soluzione poco solida. La strada pratica, oggi, è un’altra: far girare tutto in locale con uno stack leggero, chiaro e gestibile anche da chi non vuole complicarsi la vita.

La combinazione più sensata, in questo momento, è questa: Ollama per eseguire i modelli in locale, Open WebUI per avere un’interfaccia comoda nel browser e n8n solo quando vuoi trasformare quel setup in un piccolo sistema operativo fatto di workflow, trigger e azioni automatiche. Non serve partire da tutto insieme. Anzi, nella maggior parte dei casi partire subito con tre livelli diversi è il modo più veloce per complicarsi la vita.

Il vantaggio di Ollama è che abbassa molto la soglia d’ingresso. La documentazione ufficiale lo presenta come il modo più semplice per iniziare con modelli come Gemma, Qwen, DeepSeek e altri, su macOS, Windows e Linux. Questo cambia parecchio la situazione per chi vuole fare test reali senza passare subito da chiavi API, dashboard esterne e limiti di utilizzo che cambiano nel tempo. Guarda il Quickstart ufficiale di Ollama per partire dalla base giusta.

Il secondo pezzo che fa la differenza è Open WebUI. Qui il punto non è solo “avere una chat carina”. Il vero valore è che rende il setup locale utilizzabile da subito: apri il browser, gestisci la connessione a Ollama, provi i modelli, tieni una cronologia, lavori in un ambiente molto più naturale rispetto al terminale. Open WebUI si definisce infatti una piattaforma self-hosted, user-friendly e progettata per operare anche offline. Se vuoi vedere da dove partire, c’è il Getting Started di Open WebUI e la guida Starting with Ollama.

A questo punto arriva la domanda giusta: serve davvero n8n?

La risposta onesta è no, non all’inizio. Se il tuo obiettivo è avere un assistente locale semplice, puoi fermarti benissimo a Ollama + Open WebUI. n8n entra in gioco quando vuoi aggiungere qualcosa di operativo: leggere dati, attivare processi, collegare servizi, costruire mini-agent che fanno passaggi ripetibili. In altre parole, n8n non è il punto di partenza obbligatorio. È lo step successivo quando smetti di voler solo “chattare con un modello” e vuoi invece “far fare cose” a quel sistema. La documentazione n8n va esattamente in questa direzione, con il nodo Ollama e il Self-hosted AI Starter Kit.

Qui entra in gioco un’altra idea importante: non hai bisogno di un “mega framework multi-agent” per iniziare bene. Anzi, spesso è il contrario. Ollama supporta già il tool calling, cioè la possibilità per il modello di invocare strumenti e incorporarne i risultati. Open WebUI ha un sistema di tools e functions che permette di estendere il comportamento dell’assistente senza trasformare il setup in un progetto ingestibile. Per molti casi reali, questa è già una forma utile di agente locale: piccolo, leggibile, controllabile. Tool calling in Ollama, Tools in Open WebUI e Functions in Open WebUI spiegano bene questo passaggio.

Se vuoi immaginare l’architettura più semplice possibile, pensa a tre strati.

Il primo è il motore: Ollama.

Il secondo è la faccia: Open WebUI.

Il terzo è l’automazione: n8n, ma solo quando ti serve davvero.

Questa struttura funziona perché ogni pezzo ha un ruolo netto. Non stai cercando un oggetto magico che faccia tutto. Stai costruendo un sistema che puoi capire, avviare e modificare senza perdere il controllo.

Il motivo per cui questo approccio convince sempre di più è semplice: ti restituisce prevedibilità. Con il cloud gratuito sei sempre esposto a cambi di limiti, disponibilità del modello, rate limit, tier che spariscono o funzioni che si spostano dietro un piano a pagamento. In locale, invece, il limite principale è il tuo hardware. È un limite reale, certo, ma almeno è chiaro. E soprattutto ti evita di ricostruire ogni mese il tuo flusso di lavoro attorno a regole che non controlli.

Detto questo, “semplice” non vuol dire “senza attenzione”. La vera semplicità nasce quando fai poche scelte giuste. La prima: usa modelli compatibili con il tuo hardware, non inseguire subito quello più grande. La seconda: parti dall’interfaccia, non dal framework. La terza: aggiungi automazione solo quando una routine si ripete davvero. Questo è il punto in cui n8n ha senso. Prima, rischia solo di allargare il setup senza darti un vantaggio concreto.

Un altro dettaglio interessante è che Open WebUI sta lavorando molto anche sulla parte pratica d’uso. C’è perfino una guida per creare un launcher one-click che avvia insieme Ollama e Open WebUI e apre direttamente l’interfaccia nel browser. È un segnale chiaro: la direzione non è “più complesso”, ma “più avvicinabile” per chi vuole usare questi strumenti ogni giorno senza riti tecnici inutili. Puoi vederla qui: One-Click Ollama + Open WebUI Launcher.

Se vuoi partire bene, il percorso più pulito è questo.

Installa Ollama.

Collegalo a Open WebUI.

Prova due o tre modelli adatti alla tua macchina.

Lavora qualche giorno così.

Solo dopo, se capisci che vuoi flussi automatici, aggiungi n8n.

Questo approccio ti evita il classico errore di chi parte da una visione troppo grande e si ritrova con un sistema tecnicamente interessante ma scomodo da usare davvero.

Video tutorial affidabili da vedere

Per evitare di perderti in tutorial casuali, il criterio migliore è semplice: prima fonti ufficiali o quasi-ufficiali, poi walkthrough pratici.

Parti da questi:

Poi puoi affiancare questi video/tutorial utili:

Il criterio qui è importante: usa i video per vedere i passaggi, ma tieni sempre aperta la documentazione ufficiale per evitare setup vecchi o incompleti.

La sintesi vera

Se vuoi davvero un sistema semplice, non devi cercare “la piattaforma perfetta”. Devi togliere peso.

Ollama ti dà il motore locale.

Open WebUI ti dà un’interfaccia davvero usabile.

n8n ti dà automazione quando serve, non prima.

È questa la differenza tra un setup che resta acceso una settimana e uno che diventa parte del tuo lavoro quotidiano.

FAQ

Serve per forza una GPU?

No. Ollama gira anche senza GPU dedicata, ma prestazioni e modelli utilizzabili dipendono molto dall’hardware disponibile. La scelta del modello va fatta in modo realistico rispetto alla macchina che hai.

Posso usare solo Ollama e Open WebUI senza n8n?

Sì, ed è spesso il punto di partenza migliore per chi vuole semplicità vera. n8n diventa utile quando vuoi creare workflow, integrazioni o automazioni ripetibili.

Open WebUI funziona anche offline?

Sì, Open WebUI si presenta come piattaforma self-hosted progettata per operare anche offline, con guide dedicate anche alla modalità offline.

Ollama può già fare cose “da agente”?

Sì, supporta tool calling, cioè la capacità del modello di invocare strumenti e usare il loro output nella risposta.

n8n è obbligatorio per creare agenti locali?

No. Per molti casi basta un agente leggero costruito attorno a modello locale + tools. n8n è utile quando vuoi orchestrare passaggi, integrazioni e logiche di workflow in modo visuale.